Votre abonnement au Blog Genesys a bien été enregistré !

Please add genesys@email.genesys.com to your safe sender list to ensure you receive the weekly blog notifications.

Abonnez-vous à notre newsletter gratuite et recevez les nouveautés de notre blog directement dans votre boîte de réception.

Ne plus afficher.

Imaginons qu’un agent virtuel redirige le problème de facturation d’un client vers un système back-end, soumette une anomalie à un avis humain et propose un remboursement avant même que le client ne l’ait demandé. Avec l’IA agentique, ce scénario imaginaire sera bientôt une réalité.

Aujourd’hui, l’IA se situe en première ligne de l’activité des entreprises. Elle réagit aux nuances, s’adapte en temps réel et génère des résultats en recourant le moins possible à l’intervention humaine. Ces systèmes reconnaissent des objectifs et ajustent leur comportement pour les atteindre. Ils fonctionnent de manière transverse à tous les départements, sur tous les points de contact, voire même dans les écosystèmes de partenaires.

C’est ainsi que nous entrons dans l’ère de l’agentivité, caractérisée par une technologie sophistiquée capable d’interpréter l’intention et de coordonner les actions en fonction d’objectifs définis. Or, sans gouvernance claire, chaque décision de l’IA s’accompagne de nouveaux risques.

De nombreux prestataires n’hésitent pas à vanter « l’autonomie » de leurs solutions d’IA, mais il s’agit d’une exagération. En effet, l’IA actuelle n’est pas entièrement autonome. Elle est encore incapable de concevoir des stratégies ou de fonctionner seule dans des environnements complexes, sans l’intervention d’un humain.

À l’heure actuelle, l’IA peut être qualifiée de semi-autonome : elle repose sur des contextes prédéfinis et une supervision humaine continue.

Non seulement faire l’amalgame entre « semi-autonomie » et « autonomie » est une erreur factuelle, c’est aussi trompeur pour l’entreprise cliente. Un lancement de produit trop tape-à-l’œil cache souvent des problèmes de fond. La démo met en valeur la puissance et la vitesse du nouvel outil, mais ne s’attarde pas sur les questions de transparence, de contrôle ou de mesures éthiques. Dans un monde où l’IA exécute des milliers de micro-décisions par minute, sauter l’étape de la gouvernance revient à retirer les freins d’une voiture parce qu’elle a un meilleur moteur.

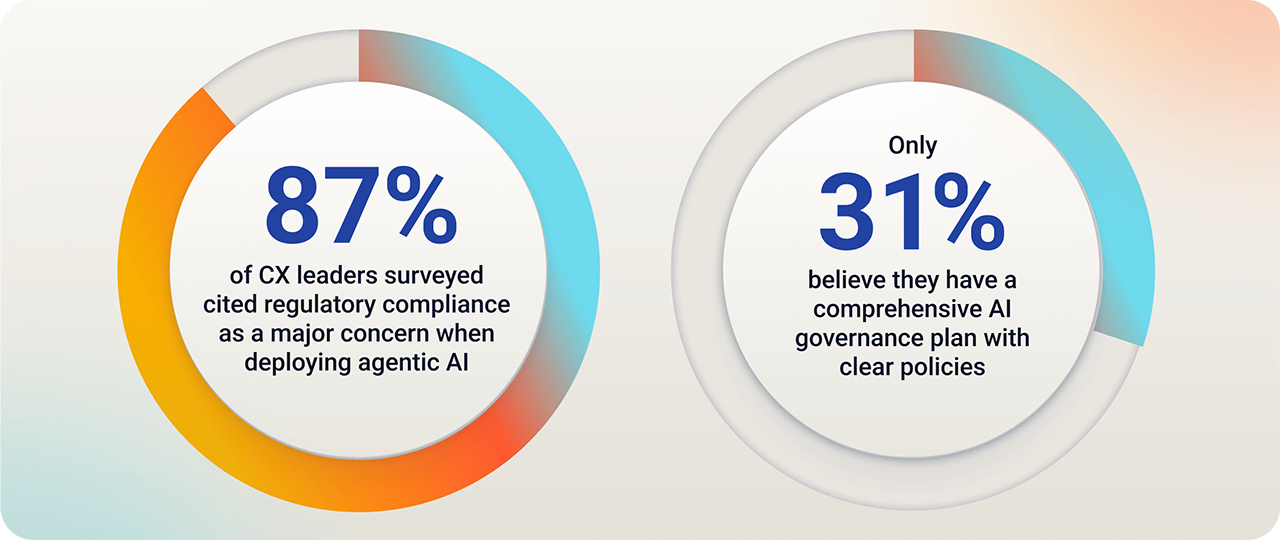

Selon un nouveau rapport Genesys, 87 % des responsables CX interrogés classent la conformité parmi leurs préoccupations majeures lorsqu’ils déploient l’IA agentique. Mais seulement 31 % pensent disposer d’un plan complet et de politiques claires de gouvernance de l’IA. Plus alarmant encore, 28 % des responsables d’entreprises qui ne disposent pas de politique de gouvernance de l’IA se sentent prêts à déployer l’IA agentique.

Cet écart est dangereux pour les entreprises. Si elle n’est pas contrôlée, l’IA agentique peut s’éloigner des politiques établies, générer de fausses informations et éroder la confiance des clients en quelques secondes.

D’autant que des protections ne peuvent pas être ajoutées a posteriori. Pour atténuer les risques de l’IA agentique, votre gouvernance doit passer d’une posture de conformité réactive à une orchestration proactive.

À l’heure où l’innovation s’accélère, de nombreuses entreprises ont encore du mal à mettre en place des contrôles de l’IA. Cette incapacité devient même un véritable handicap au niveau stratégique.

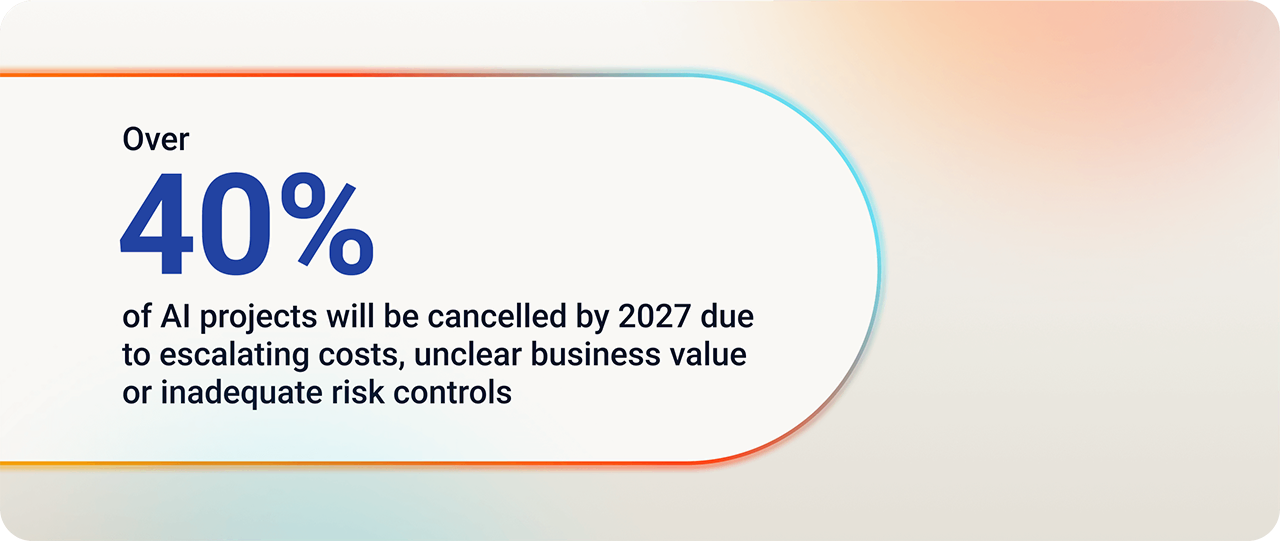

Selon Gartner ®, « plus de 40 % des projets d’IA seront annulés d’ici 2027 en raison d’une escalade des coûts, d’une valeur métier peu claire ou de contrôles inadéquats des risques. »

Ces chiffres parlent d’eux-mêmes. Près de la moitié des initiatives d’IA risquent d’échouer… Et ce, en grande partie à cause du manque de gouvernance.

Les enjeux sont donc clairs. À mesure que l’IA s’ancre plus profondément dans l’expérience client, il ne suffit plus de s’intéresser à ses seules capacités intrinsèques. Il faut aussi délimiter son champ d’action – et déterminer si son comportement est assez fiable pour l’utiliser sans mettre en péril les relations clients, l’intégrité de la marque et la conformité aux réglementations.

Ne pas prioriser la gouvernance de l’IA expose votre entreprise à de vrais risques opérationnels et réputationnels. Cela limite aussi considérablement le potentiel et la vitesse d’évolution de votre IA.

L’automatisation traditionnelle suit des règles bien définies. Le bot détecte une requête, exécute un script et produit un résultat. Ce scénario est prévisible, rigide et utile – mais limité.

Les systèmes agentiques se comportent différemment. Ils agissent en fonction d’objectifs, évaluent leur environnement et sont capables d’ajuster leurs actions en conséquence. Les développeurs n’ont pas besoin de programmer tous les chemins possibles, car l’IA trace son propre itinéraire.

Ces capacités ouvrent un tout nouveau champ des possibles. Les agents virtuels ressemblent de moins en moins à des assistants digitaux et de plus en plus à des collaborateurs capables de résoudre eux-mêmes des problèmes. Ils peuvent reconnaître les situations qui nécessitent un humain, adapter les conversations à tout moment et demander des éclaircissements au lieu de faire des suppositions à l’aveugle. Ainsi, les solutions deviennent plus intelligentes – mais aussi plus difficiles à contrôler. La même flexibilité qui fait toute la puissance de l’IA agentique introduit également des risques.

C’est pourquoi il est impératif d’établir un cadre de gouvernance. Dès le départ, les entreprises doivent développer des systèmes explicables, alignés sur leurs valeurs et suffisamment flexibles, tout en gardant le contrôle.

Sans ces mesures, une IA indépendante peut introduire des risques si rapidement que l’entreprise n’a pas le temps de réagir. Ses erreurs ne sont alors plus de simple possibilités, mais des réalités bien palpables pour le client.

Les entreprises doivent donc définir des règles en amont (ce qui entre et n’entre pas dans le champ d’action des systèmes d’IA semi-autonomes, comment ces derniers doivent réagir lorsqu’ils sont confrontés à l’incertitude, etc.). Elles doivent également mettre en place des outils permettant de suivre le comportement de l’IA et de corriger le tir en temps réel.

Lorsque l’IA agit selon ses choix et non des scripts, la gouvernance joue un rôle différent : elle impose des contraintes à l’IA et l’entraîne à reconnaître ce qui compte pour votre entreprise. Ainsi, elle garantit que son jugement s’aligne sur vos valeurs et sur les attentes des clients.

Chez Genesys, toutes les solutions d’IA sont conçues dans un souci de responsabilité. Notre engagement en faveur de la transparence et de la gouvernance de l’IA constitue un principe fondamental qui se reflète à travers tous nos produits. Nous intégrons la conformité, les mesures de sécurité, la clarté et le contrôle de l’IA directement à l’architecture de nos solutions afin que les entreprises n’aient pas à le faire plus tard.

En privilégiant la confidentialité, l’équité et la sécurité dès le départ, nous permettons à nos clients d’utiliser l’IA en toute sécurité et de manière responsable. Notre objectif est de concevoir une IA digne de confiance qui améliore l’expérience client et s’aligne sur vos valeurs.

Cette vision permet de garder le contrôle sur votre IA en suivant son comportement en temps réel, en signalant les problèmes et en tenant un journal détaillé de chaque action pour mener des audits ou des analyses plus approfondies.

Les superviseurs ont accès à des fonctionnalités de surveillance de l’IA en direct, avec la possibilité d’intervenir. Ils peuvent suspendre les décisions, corriger la réponse générée par l’IA ou reprendre les commandes du système lorsqu’un jugement humain est nécessaire.

En intégrant la confiance, l’équité et la confidentialité aux modèles d’IA, l’apprentissage se fait toujours sous votre vigilance. Les boucles de feedback renforcent les bons résultats et éliminent tout ce qui est inutile. Ainsi, les modèles savent quand l’IA doit ou non intervenir, par exemple lorsque les données sont réglementées ou qu’un protocole de redirection s’applique. Résultat : l’IA n’agit que dans les limites que vous avez définies, même lorsqu’elle se retrouve dans une nouvelle situation.

Ces mesures diffèrent de la gouvernance traditionnelle de l’IA. Elles forment une « constitution agentique » qui inscrit vos valeurs, vos politiques et vos objectifs au cœur de chaque décision prise par l’IA.

C’est pour cela qu’ont été créés Genesys Cloud™ AI Studio et sa fonctionnalité phare, Genesys Cloud™ AI Guides. Ensemble, ces capacités vous permettent de créer des expériences d’IA plus efficaces et responsables tout en préservant les valeurs de votre marque.

AI Guides permet aux entreprises de créer des expériences agentiques axées sur des objectifs, dynamiques et responsables. Il suffit que les utilisateurs décrivent ce que doit accomplir l’IA pour qu’AI Guides traduise cette vision en comportements définis, traçables et toujours en phase avec vos règles d’éthique.

Des résumés des fonctionnalités de Genesys Cloud AI Studio, AI Guides et les résumés de conversation personnalisés sont désormais disponibles.

Genesys définit la courbe de maturité de l’IA en six niveaux d’orchestration de l’expérience. Le niveau 1 est la phase de l’automatisation statique, des scripts rigides, des flux fixes et des interventions manuelles. Au niveau 2, les systèmes deviennent réactifs et déclenchent des actions, mais toujours en suivant des règles, sans appréhender le contexte. Selon Genesys, la plupart des entreprises se situent à ce niveau.

Le niveau 3 introduit des capacités de prédiction. L’IA est désormais capable d’anticiper, mais a toujours besoin des humains pour passer de l’intention à l’action.

AI Guides vous propulse au niveau 4, celui de l’intelligence semi-autonome. Ici, l’IA prend l’initiative. Elle respecte vos limites et apprend de ses résultats pour s’améliorer sans nécessiter un entraînement constant. Ainsi, vos équipes passent de la simple gestion des tâches au pilotage de systèmes intelligents, qui les aident réellement à alléger la charge de travail.

La conception rigoureuse d’AI Guides prépare le terrain pour le niveau suivant : l’orchestration agentique universelle (niveau 5). À ce niveau, les agents d’IA collaborent, partagent le contexte, rééquilibrent les priorités et affinent les actions en totale autonomie. L’ensemble du système apprend en continu dans une totale coopération.

Avec Genesys, vous disposez des outils nécessaires pour vous lancer vers les niveaux supérieurs de l’IA. Alors que d’autres entreprises s’efforcent de rester dans la course, vous avez toutes les cartes en main pour développer une IA qui fonctionne vraiment. La voie à suivre est toute tracée. À vous de l’emprunter pour vous différencier. Ensemble, faisons rimer audace et responsabilité.

Découvrez les cinq principes fondamentaux qui guident la conception, l’évolution et le déploiement de nos systèmes d’IA pour parvenir à des résultats éthiques, sûrs et centrés sur l’humain.

Communiqué de presse de Gartner, « Gartner Predicts Over 40% of Agentic AI Projects Will Be Canceled by End of 2027 », 25 juin 2025

GARTNER est une marque déposée et une marque de service de Gartner, Inc. et/ou de ses filiales aux États-Unis et dans le monde entier et est utilisée dans le présent document avec autorisation. Tous droits réservés.

Abonnez-vous à notre newsletter gratuite et recevez les nouveautés du blog de Genesys directement dans votre boîte de réception.