La tua iscrizione ai blog Genesys è stata confermata!

Please add genesys@email.genesys.com to your safe sender list to ensure you receive the weekly blog notifications.

Iscriviti alla nostra newsletter gratuita e ricevi gli aggiornamenti sui blog nella tua casella postale

Non mostrare più questo messaggio.

La rapida ascesa dell’intelligenza artificiale (AI) agenziale sta cambiando il modo in cui le organizzazioni interagiscono con i clienti e lo svolgimento dei flussi di lavoro in ambito Customer Experience (CX). Oggi le principali aziende utilizzano l’AI per orchestrare interazioni in tempo reale personalizzate, proattive e sempre più semi-autonome .

Ecco che, con la curva di adozione dell’AI che ha superato la fase di proof-of-concept, le aziende ora si aspettano risultati tangibili, un vantaggio competitivo e un un ritorno sugli investimenti misurabile. Ma mentre ci sono tante opportunità offerte dall’AI, lo stesso vale anche per i rischi.

I responsabili tecnici si trovano quindi ad affrontare una doppia sfida: innovare garantendo al contempo la sicurezza Le organizzazioni devono diffondere le innovazioni CX alimentate dall’AI mentre gestiscono anche una gamma di rischi in espansione. Tra questi ci sono violazioni della conformità, instabilità geopolitica, cyberattacchi guidati dall’AI, compromissioni dei dati e interruzioni dei servizi.

Di fronte a tali sfide, non è più possibile relegare in secondo piano le pratiche CX responsabili. Di fatto si tratta ormai di priorità strategiche e, con l’innovazione che sta accelerando, integrare la responsabilità e la trasparenza a tutti i livelli della Customer Experience non è mai stato così importante.

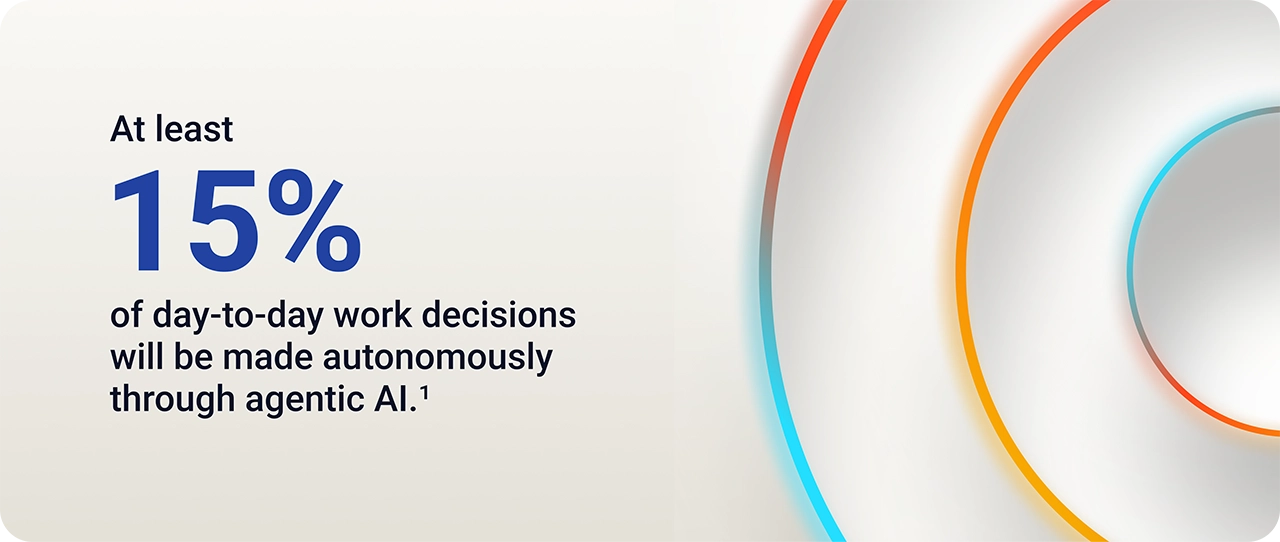

Le aziende sono soggette a una reale esigenza di innovazione. Il clima competitivo richiede Customer Experience più automatizzate e personalizzate, di cui l’AI è l’abilitatore chiave. Secondo Gartner®, “entro il 2028, almeno il 15% delle decisioni professionali quotidiane sarà preso autonomamente tramite l’AI agenziale, rispetto allo 0% del 2024”1. Questo enorme balzo rispetto ai punti di riferimento attuali segna l’alba di un’ampia diffusione del processo decisionale tramite AI.

Tuttavia, un’implementazione dell’AI affrettata e priva di adeguate misure di protezione crea vulnerabilità significative. E niente è più dannoso dell’erosione della fiducia del cliente.

Questa transizione verso l’intelligenza artificiale agenziale richiede una governance rigorosa e una supervisione etica dell’AI. I CXO responsabili della tecnologia e della conformità devono garantire che l’AI sia affidabile, trasparente, equa e spiegabile, nel rispetto degli standard di sicurezza e riservatezza.

Ad aggiungere complessità a questo scenario c’è il fatto che i dati stessi che alimentano questi sistemi intelligenti sono un obiettivo per minacce sempre più sofisticate. Oggi gli avversari stanno sfruttando l’AI per automatizzare gli attacchi, migliorare le campagne di phishing e persino adattare le loro tattiche in tempo reale. Le aziende devono quindi adottare una strategia di sicurezza proattiva e adattiva che, idealmente, sfrutti l’AI per rilevare e neutralizzare le minacce.

La realtà è che i sistemi alimentati dall’AI sono ormai considerati infrastrutture critiche. Quando i servizi di AI rivolti ai clienti incorrono in dei problemi, gli effetti si ripercuotono sull’intero customer journey, rendendo essenziali le funzionalità di ridondanza e recupero rapido.

Oggi, pianificare la resilienza significa garantire la disponibilità dei sistemi di AI così come di altri sistemi strategici per la Customer Experience. Questo cambiamento si riflette in normative come la direttiva europea NIS2 (Network and Information Security 2) e il Digital Operational Resilience Act (DORA) , che richiedono chiare informative sulla gestione del rischi legati all’AI e sulla resilienza operativa.

L’innovazione dell’AI non mostra segni di rallentamento. I CXO devono raggiungere un difficile equilibrio: come innovare rapidamente e in modo sicuro?

Adottare un approccio troppo prudente comporta il rischio di rimanere indietro rispetto ai concorrenti più coraggiosi. Implementare l’AI senza misure di protezione significa d’altro canto esporsi a conseguenze reputazionali, operative e normative.

La sfida non è solo tecnologica. L’evoluzione del quadro normativo e geopolitico crea infatti nuovi vincoli operativi per le aziende.

Questa pressione risulta particolarmente evidente se si guarda all’evoluzione della conformità a livello globale. Essa è troppo rapida per la maggior parte delle aziende, che devono adattarsi a quadri normativi come l’ EU AI Act e ISO/IEC 42001 che stabiliscono la base per un’AI responsabile. Nel contempo regolamenti come il GDPR impongono standard rigorosi in materia di privacy e governance dei dati.

Uno dei cambiamenti più significativi è stato l’emergere di nuovi requisiti di sovranità, che stanno ridefinendo le attività delle organizzazioni nelle varie regioni, compresa la progettazione e la scalabilità della Customer Experience. Spinti dalla sicurezza nazionale, dalla sovranità digitale e dal protezionismo economico, i governi di tutto il mondo stanno inasprendo le regole relative all’archiviazione, al trattamento e all’accesso ai dati dei clienti.

Un recente articolo di McKinsey & Company rivela che più del 70% dei paesi dispone di proprie leggi sulla protezione dei dati e sulla privacy. Sempre più spesso, le direttive sulla sovranità si estendono ulteriormente su chi controlla i dati e dove si trovano le persone ed entità coinvolte. Questi obblighi di vasta portata hanno dato origine ai “cloud sovrani”.

Inoltre le disposizioni hanno causato una frammentazione geopolitica che può rallentare e complicare la trasformazione della CX. I responsabili IT devono ora dedicare tempo significativo ai confronti sull’architettura dei fornitori, esaminando dove fluiscono i dati, quali giurisdizioni vi hanno accesso e stabilire un piano per anticipare i cambiamenti normativi.

La realtà è che oggi la conformità normativa sta ridefinendo il modo in cui le soluzioni per la CX vengono costruite e implementate. Offrire una Customer Experience su larga scala non è solo una sfida tecnologica, ma comporta anche questioni architetturali e di governance.

Offrire ai clienti esperienze alimentate dall’intelligenza artificiale su larga scala non richiede solo competenze tecniche. Richiede un approccio strategico che tenga conto fin dall’inizio di fiducia, rischio, normative e resilienza.

Ecco cinque priorità non negoziabili per i responsabili della CX che devono gestire questa complessità.

La sicurezza deve essere integrata a tutti i livelli della piattaforma per la Customer Experience, dall’infrastruttura e dalle applicazioni al rilevamento di identità, dati e minacce. Più gli attacchi informatici sono mirati e complessi, più sono necessari controlli integrati e monitoraggio in tempo reale. Collabora quindi con fornitori che dimostrano pratiche di sicurezza mature attraverso certificazioni di terze parti come ISO/IEC 27001, SOC 2 e equivalenti regionali (ad es., C5, IRAP, ENS High). Queste attestazioni non sono opzionali, sono un prerequisito.

Man mano che i sistemi di AI acquisiscono autonomia, le decisioni che prendono – e i dati che li modellano – comportano conseguenze concrete in termini di normative e reputazione. I responsabili della CX necessitano di una chiara visibilità su come vengono addestrati i modelli, come vengono reperiti e protetti i dati e come vengono monitorati e mitigati i pregiudizi dell’AI per un equilibrio rappresentativo a livello linguistico, regionale e demografico. Scegli partner che pubblicano i loro principi etici dell’AI, forniscono strumenti esplicativi quali schede dei modelli AI e offrono controlli di governance come standard.

Di fronte alla rapida evoluzione delle leggi sulla privacy dei dati in tutte le giurisdizioni, i sistemi dedicati alla CX devono fornire un controllo totale sul luogo di archiviazione dei dati, sul loro movimento e sulle persone che possono accedervi. Questo va oltre la conformità. È un tema fondamentale per guadagnare la fiducia del cliente e mantenere la credibilità del brand. Una governance solida assicura anche che le organizzazioni sappiano come i dati dei clienti alimentano i modelli AI, generando così risultati più trasparenti e responsabili.

Anche brevi interruzioni possono compromettere customer journey critici e danneggiare la fidelizzazione. Ecco perché una CX responsabile richiede piattaforme che combinino alta disponibilità, scalabilità elastica e aggiornamenti senza soluzione di contiunuità. Valuta la capacità dei fornitori di rispettare gli accordi sui livelli di servizio (SLA), mantenere la ridondanza globale e offrire visibilità pubblica dello stato del sistema e della cronologia degli incidenti. L’affidabilità è un fattore imprescindibile.

La CX è una responsabilità condivisa e non deve essere di esclusiva competenza del reparto IT. Tutti i team svolgono un ruolo essenziale nella gestione dei rischi legati all’AI e nel mantenimento di pratiche responsabili, che si occupino di temi legali, di conformità, privacy, sicurezza, operazioni e di interazione diretta con i clienti. Stabilisci un quadro di governance chiaramente sostenuto dalla direzione, con ruoli definiti e responsabilità condivisa tra i team per abbattere i silos ed evolvere in modo responsabile

Nell’era dell’AI agenziale, le organizzazioni che puntano a diventare leader non scelgono tra innovazione e fiducia. Questi due motori di crescita sono inseparabili ai loro occhi.

Con l’accelerazione dell’AI, la loro doppia missione di innovazione e protezione non può essere sottovalutata. La governance deve affermarsi come un modello operativo fondamentale che pone la trasparenza, la sicurezza, la riservatezza e la resilienza su un piano di parità con la velocità dell’innovazione e la scalabilità.

Ponendo l’accento sulla responsabilità, le aziende possono implementare l’AI in tutta sicurezza, adattarsi rapidamente, agire con integrità e conquistare la fiducia dei clienti in modo duraturo.

Sei pronto a valutare la tua attuale architettura CX o una nuova piattaforma per la Experience Orchestration alimentata dall’AI? Scopri come Genesys Cloud™ AI ti consente di automatizzare e ottimizzare strategicamente e in sicurezza l’intera Customer Experience.

1 Fonte: Articolo Gartner, 2025 Top Strategic Technology Trends, Gene Alvarez, 21 ottobre 2024

GARTNER è un marchio registrato e marchio di servizio di Gartner, Inc. e/o delle sue affiliate negli Stati Uniti e a livello internazionale e viene utilizzato nel presente documento previa autorizzazione. Tutti i diritti riservati.

Iscriviti alla nostra newsletter gratuita e ricevi gli aggiornamenti sui blog Genesys nella tua casella postale.